Sono tempi in cui il rumore di fondo assorbe e impensierisce. Sulle mie pagine prevale spesso il silenzio, tranne per qualche rara analisi politica o sociologica, che reclamerebbe perfino più spazio.

Oggi provo a rientrare nei registri che mi sono più cari.

Poche settimane fa ho deciso di infilare la testa in uno dei meccanismi più spietati, severi e affascinanti che l'umanità abbia mai inventato: la Peer Review (la revisione tra pari) accademica. Potevo fermarmi alla Open Science (OS), ossia la scienza aperta che consente a chiunque di pubblicare lavori scientifici, ed è sempre un passo preliminare importante per fissare il “campo base” delle proprie ricerche e garantire accesso libero e immediato alla comunità scientifica.

Potevo, sì… Ma c’è molto altro che merita attenzione nel campo della ricerca.

Si parte studiando e conoscendo molto bene le discipline di cui ci si vuole occupare, mantenendosi aggiornati sullo stato dell’arte (SOTA, State Of The Art) relativo a determinati saperi di quelle discipline. I ricercatori individuano così delle necessità: ciò che può essere migliorato oppure qualcosa di totalmente innovativo, come una nuova soluzione tecnologica, una teoria più avanzata, e così via. Ci si cimenta iniziando a compiere studi puntuali e articolati, che devono rispettare i canoni rigidi e severi della narrativa scientifica: introdurre il lavoro, descrivere cosa dice la letteratura disponibile, citare puntualmente la bibliografia utile, elaborare la propria tesi e descrivere la teoria e/o la metodologia attorno ad essa, presentare e commentare risultati ed eventuali dati sperimentali, discutere le sfere d’interesse in cui lo studio andrà a impattare.

Se il lavoro è fatto bene sarebbe un peccato lasciarlo sedimentare solo presso la comunità OS sotto forma di preprint, ossia come studio non ancora sottoposto a una revisione tra pari, poiché rischierebbe di essere sepolto da altre migliaia di preprint privi di pregio (talvolta molto scadenti) che quotidianamente vengono inseriti in questi fondamentali ecosistemi (arXiv, Zenodo, PhilArchive, medRxiv, etc.). Perciò sarebbe anche utile portare il proprio contributo il più vicino possibile alla comunità scientifica di riferimento, affinché se ne possano occupare assicurando una peer review accurata (revisione tra pari) e così stabilendo se tale lavoro può davvero rappresentare una risorsa di valore e un possibile avanzamento scientifico.

Entrano in gioco le riviste scientifiche, edite da università, centri di ricerca, fondazioni pubbliche e private, classificate per prestigio e importanza a livello nazionale e internazionale, solitamente indicizzate in sistemi bibliografici e citazionali del calibro di Scopus, WoS, PubMed, DOAJ, e diversi altri. Alcuni comitati editoriali di queste riviste si curano anche di intercettare gli studi promettenti già pubblicati in OS, ma nella maggior parte dei casi si dovrà bussare direttamente all’editore chiedendogli di prendere in considerazione il proprio studio. La rivista farà un’analisi preliminare, giudicando se è stata rispettata la forma rigorosa che abbiamo descritto prima, e se lo studio tratta un contributo davvero interessante e originale. Il superamento di questi filtri preliminari fornisce già la misura di aver effettuato un buon lavoro, che a tal punto l’editore prenderà in considerazione avviandolo verso la fase più rigorosa di tutte: la famosa peer review, che ho simpaticamente chiamato “tritacarne”,

La peer review di uno studio coinvolge accademici e scienziati nel campo a cui si rivolge lo studio stesso, invitati dall’editore come revisori che dovranno impegnare considerevoli risorse intellettuali e di tempo per “fare a fettine” lo studio: paragrafo dopo paragrafo, rigo dopo rigo, entrando nell’intimo della proposta, delle prove, dei dati, delle citazioni, recuperando il SOTA e ogni altro brandello di letteratura a conferma o contrasto del lavoro proposto. All’impegno dei revisori raramente consegue una remunerazione adeguata, anche a causa dei molti costi di gestione che già affronta l’editore della rivista (editing, piattaforma, indicizzazione, margini editoriali, etc.) ed è per questo che le riviste scientifiche sono talvolta a pagamento: per l’accesso da parte dei ricercatori o per la consultazione delle pubblicazioni, oppure per entrambe le cose. Esistono anche riviste ad accesso e consultazione gratuite, quasi sempre co-finanziate da enti pubblici, università e fondazioni di ricerca, così da avere comunque il budget necessario per le spese vive. Esiste molto volontariato, ed è soprattutto in questo mondo che tale genere di attività gratuita si estrinseca nei suoi più nobili propositi: promuovere l’indipendenza e il progresso, oltre la “vil pecunia”.

Il grigiore esistente in certi ambienti accademici, ermetici e autoreferenziali, che spesso gestiscono e limitano l’accesso a determinate riviste di particolare influenza (noi le conosciamo come “baronie”) è oggi sempre più compensato dall’eterogeneità della comunità scientifica. La scienza è in buona parte uscita dalle stanze autoritarie di un tempo attraverso persone e risorse che tracciano molteplici percorsi. Ogni ricercatore può (e deve!) identificare i percorsi migliori e percorrerli con determinazione per far emergere la propria intuizione, il lavoro, il contributo che si ritiene come piccolissimo passo avanti dell’umanità.

Dal frullatore della peer review, molto raramente si uscirà con le ossa integre e l’accettazione as is (così com’è) del proprio lavoro. Usualmente vengono segnalate criticità e richieste di correzioni maggiori o minori, e se tutto va bene si accede ad altri cicli di valutazione man mano che il lavoro avanza verso il suo stadio di modellazione finale. Non è infrequente che uno studio venga alla fine rigettato, perché nonostante gli sforzi non si è riusciti a consolidare l’impalcatura che sembrava reggerlo. E non è mai una sconfitta, ma lo scoprire nuove direzioni di lavoro che prima di questo rigoroso brainstorming sarebbe stato difficile scorgere. Dunque è sempre un passo avanti per chi fa ricerca; un nuovo stimolo e un’altra base da cui ripartire per fare meglio.

Avvengono degli errori durante questi processi? Certamente!

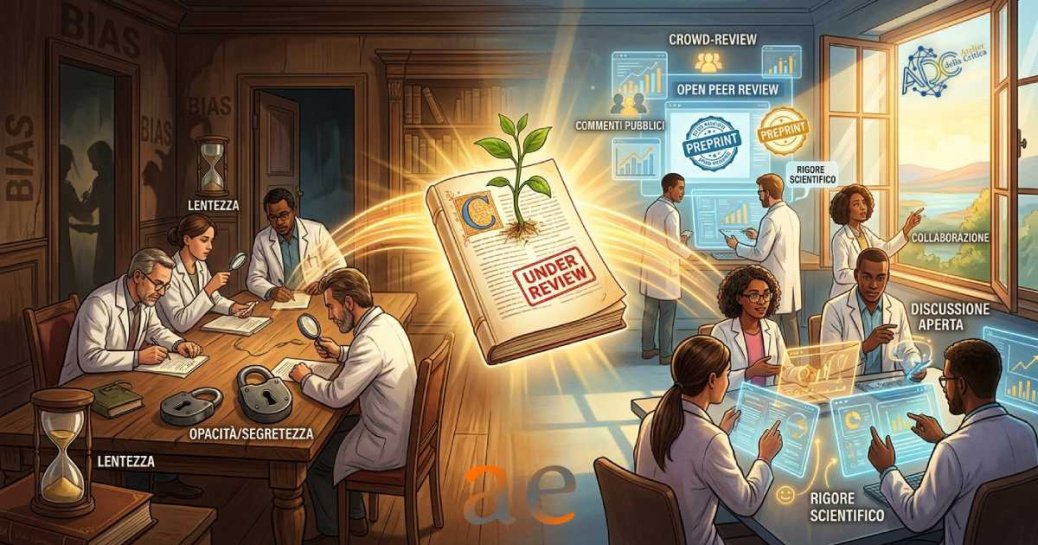

Bisogna anzitutto ammettere che abbiamo un elefante nella stanza. Il sistema tradizionale della revisione scientifica, per quanto sia il migliore che abbiamo ideato finora, ha una ferita aperta: è una scatola nera. Oggi, se uno studio viene rigettato dopo mesi di durissime critiche da parte dei revisori, cosa succede? Nulla. Lo studio viene respinto e le preziose critiche intellettuali che lo hanno smontato vengono letteralmente distrutte, sepolte in archivi privati. Nessuno, tranne l'autore e l'editore, saprà mai il perché di quel rifiuto. È quello che gli addetti ai lavori chiamano il File Drawer Problem (il problema del cassetto). Si celebra solo chi vince, mentre la fatica della critica scompare nel nulla.

Questa opacità rischia di trasformare anche i migliori salotti accademici in circuiti dogmatici. Ma la scienza, quella vera, prova sempre a produrre anticorpi. Proprio in questi anni, la comunità globale sta provando a ribellarsi a questa omertà attraverso l'Open Peer Review (OPR) o modelli rivoluzionari come il Publish, Review, Curate (PCR) adottato dalla prestigiosa rivista eLife. L'idea è dirompente: non si nascondono più i fallimenti. Si pubblica lo studio e, accanto ad esso, si pubblicano integralmente i referti dei revisori, le loro critiche, i loro dubbi e le risposte dell'autore. Anche in questo caso le piattaforme di Open Science di cui parlavamo all’inizio (campo base dei preprint) giocano un ruolo di primo piano, essendo un territorio naturale per applicare protocolli OPR/PCR, come sta già avvenendo.

Accanto a questa “cura” in atto ci sono naturalmente altri difetti.

Per esempio, nel campo delle cosiddette “scienze dure” (fisica, biologia, medicina, etc.) il padre della teoria sulla deriva dei continenti, Alfred Wegener, ai suoi tempi (1912) fu ridicolizzato e deriso dai propri colleghi. Solo negli anni ‘60 molti di quegli studi vennero rivalutati con la scoperta della tettonica delle placche. Non da meno nelle scienze umane e sociali (psicologia, sociologia, economia, etc.), dove si bocciava senza appello Aaron Beck e i suoi studi sull’efficacia della psicoterapia cognitiva. Tutte le principali riviste respinsero i suoi lavori, ma oggi la CBT (Cognitive Behavioral Therapy) è il trattamento standard più supportato da prove scientifiche.

Non sempre è colpevole il sistema. Accade più spesso che ottimi lavori siano solo carenti dal punto di vista dei dati o delle sperimentazioni, e debbano quindi maturare sotto tale profilo. A parte questo, le imperfezioni che ruotano attorno al mondo del consenso scientifico sono le stesse che affliggono ogni altra espressione di qualità umana. Non siamo perfetti; si litiga anche mentre si disquisisce della cosa più rigorosa di cui l’uomo si sia mai occupato: la scienza, fatta di fenomeni da osservare e capire, di modelli in grado di descrivere tali fenomeni, il tutto attraverso un realismo critico che ci fornisce qualche buon strumento di analisi per capire cosa sia scienza e cosa non lo sia, cosa sia originale, innovativo, utile, e cosa no. Ai giorni nostri gli spazi sono aumentati, gli errori più contenuti, l’impalcatura di validazione è diventata più solida. E quella “cura” vista prima prenderà sempre più piede, affinché anche la critica diventi letteratura.

Oggi un revisore si domanda: la spiegazione di questo argomento è troppo astrusa o complessa? Ed applica a tale ragionamento il Rasoio di Occam. E si domanda anche: i dati che stiamo osservando possono smentire le ipotesi formulate? E in tal caso applica il principio di falsificazione di Popper. Attraverso questi due principi – metodo scientifico – si mette a punto la lente che permette di osservare nella maniera più nitida possibile uno studio scientifico. Non sono mai regole assolute, come ci insegna anche la filosofia della scienza, ma rappresentano le migliori risorse euristiche oggi disponibili.

A questo modello di validazione – con tutti i suoi pregi e difetti visti – si oppongono spesso i salotti TV coi loro talk show, i giornalisti dal pezzo facile, o peggio ancora le reti social su Internet. I tempi, i modi, i luoghi, il processo di validazione scientifica che abbiano fin qui discusso, vengono sostanzialmente abusati, negati e annullati, in una serata di intrattenimento, in un post, in un articolo. Tutto ciò avviene anche con la complicità di intellettuali e scienziati autorevoli, che spesso il tempo dimentica o adombra, e i media a caccia di scoop rispolverano e lusingano. Miscela esplosiva che – dobbiamo dirlo – talvolta fa sparlare veri e propri luminari e premi Nobel, ai quali i salotti mediatici e gli eventi ingegnerizzati dalla “scienza alternativa” danno una ribalta senza domande scomode e critica scientifica.

Tutto questo è molto più grave della ricerca finanziata e filtrata da interessi economici, che pure esiste ma che fa molti meno danni ed incide sempre meno.

I più attenti faranno risalire questi scenari agli episodi più recenti che li ricordano, come quelli confinati nel periodo della pandemia da Covid 19. Voci autorevoli di un tempo, o titolati mai sentiti prima, facevano a pezzi la letteratura scientifica esistente attraverso social e salotti TV. Ma nessuno di loro sottoponeva la propria tesi a quel “tritacarne” che garantisce l’imprescindibile analisi critica tra pari. Una notevole responsabilità per chi ha partecipato a quella campagna di disinformazione che banalizzava argomenti complessi e fomentava le condizioni di incertezza e disagio generale che tutti stavamo vivendo.

Lo stesso ragionamento potremmo farlo sul tema del riscaldamento globale e della quota di responsabilità antropica. Il 95% degli studi confermano una considerevole responsabilità antropica (quindi un coinvolgimento dell’uomo) rispetto agli eventi naturali, mentre il rimanente 5% sceglie di puntare il dito quasi esclusivamente sugli eventi naturali, sollevando l’uomo da gran parte delle responsabilità.

Chi ha ragione?

Se è vero che quel 5% esiste, ed ha superato la fase "tritacarne" della peer review non va certamente ignorato. Ma è pur sempre una posizione minoritaria che l’altro 95% di letteratura boccia. Mancando ancora l’universalità di quelle “cure” OPR/PCR che farebbero divenire le critiche letteratura apprezzabile, non possiamo nemmeno sapere come e perché quel 5% abbia superato la revisione. Siamo costretti a fare un ragionamento di bias plausibile: una dispersione statistica accettabile ma irrilevante, eventualmente confermabile anche attraverso un’analisi delle citazioni. Senza scendere troppo sul tecnico, il 5% si candida a essere un bias di posizioni autoreferenziali borderline, di certo non in grado di intaccare quel 95% conforme.

Che vogliate essere l’uno o l’altro (o entrambi), dovete comunque possedere un requisito fondante: essere critici. Ed esserlo in maniera epistemica, cioè capace di intercettare le ragioni della conoscenza più genuina e individuare ciò che muove un pensiero, la qualità stessa di quel pensiero, mentre si articola in parole e frasi tentando di convincere su qualcosa.

Sapete? È proprio su tutto questo che si è basato il mio recente lavoro che in questi giorni è al vaglio di quel tritacarne della peer review. Un sistema di valutazione epistemica dai risultati aperti e criticabili, che costituisce informazione più che valutazione. Provo a gettare le basi di un progetto molto più ambizioso, il cui obiettivo etico vorrebbe essere quello di aiutare tutti noi a orientarci tra piccole verità in costante aggiornamento, e grandi fake news e mistificazioni banalizzanti dei nostri giorni.

Ve ne parlerò meglio prossimamente. Nel frattempo incrociate le dita affinché la fase di quel consenso non mi faccia davvero a fette. Ma come ho già detto: non sarebbe mai una sconfitta, ma una base da cui ripartire.

base foto: Gemini AI, Nano Banana Pro, 27/04/2026, su prompt A.E.

Gli algoritmi di ricerca su internet, e quelli preferenziali dei social, non premiano cultura, pluralismo e contenuti utili e interessanti, ma fanno prevalere le banalità, le popolarità, l'intrattenimento, e la supremazia di informazioni mainstream promosse anche da incenti investimenti pubblicitari.

Questo progetto sarebbe invisibile senza costanti investimenti di autopromozione.

CONDIVIDENDO l'articolo e segnalando il sito e i profili social, contribuirai ancora meglio.